BIO

JOSU LARRAÑAGA ALTUNA. Autor, artista, investigador. Catedrático Emérito de la Universidad Complutense de Madrid (Facultad de Bellas Artes). Ha dirigido los Grupos de Investigación Prácticas artísticas y formas de conocimiento contemporáneas (2011-2021) y Teoría y práctica del arte contemporáneo (2002-2010). Ha sido IP de los Proyectos I D Interacciones del arte en la tecnosfera. La irrupción de la experiencia (2017-2021) y Arte y política. Argentina, Brasil, Chile y España 1989-2008 (2005-2009).Trabaja en propuestas transdisciplinarias y procesos heterogéneos. Se ha ocupado especialmente de la realización de imágenes en los imaginarios, las circunstancias perceptivas y la episteme escópica de cada momento.

RESUMEN: A través de diversas iniciativas artísticas, se exploran las implicaciones de la IA en la memoria, la subjetividad y la representación cultural.

ABSTRACT: Through various artistic initiatives, the implications of AI on memory, subjectivity, and cultural representation are explored.

PALABRAS CLAVE / KEYWORDS: AI / politics / artistic practices / decolonization

“La interpretación automatizada de imágenes es un proyecto inherentemente social y político, en lugar de puramente técnico. Comprender la política dentro de los sistemas de IA es más importante que nunca”. Kate Crawford y Trevor Paglen(2022)

Este señor es Victor Maior, bibliotecario de Chyenne y desarrollador de VIC (Ciudadano Virtual Integrado) el chatbot (simulador de conversaciones) presentado a la alcaldía en las elecciones del pasado 20 de agosto de 2024, y que ha sacado 327 votos de 11036 residentes en el condado de Laramie.

Según el señor Maior (y la prensa internacional) es el primer caso en la historia en que un chatbot o una IA se presenta a unas elecciones. En España, un prestigioso periódico nacional titulaba “Una IA basada en Chat GPT hace historia al presentarse a la alcaldía de una ciudad estadounidense”, otro decía “Una IA basada en Chat GPT hace historia al presentarse a la alcaldía de una capital estadounidense”, y un tercero titulaba “El robot que se presenta a alcalde y promete acabar con la corrupción”.

Ahora bien, en el Estado de Wyoming, para postularse a un cargo es necesario estar registrado y VIC no está en condiciones de hacerlo, hasta ahora al menos.

Así que es el propio Sr. Maior (el desarrollador) quien se presenta, si bien aclara que quien dirigirá la alcaldía será VIC y él solamente será el “avatar humano” del chatbot de IA, porque “Ha llegado el momento de ir más allá de las limitaciones de los sesgos humanos y el interés propio en los cargos públicos”.

El experimento tiene al menos un precedente en la candidatura de Michihito Matsuda, un robot humanoide desarrollado por la empresa japonesa Kokoro Corporation presentado a alcalde en las elecciones municipales de abril de 2018 por el Partido Liberal Democrático de Japón en la ciudad de Tama, en la prefectura de Tokio, con cerca de 150.000 habitantes. Con 4.013 votos, quedó en tercer lugar, por encima de ocho candidatos.

Como en el caso anterior, detrás de esta “candidatura” se encontraban Tetsuzo Matsuda, que había participado como candidato en 2014 y Norio Murakami, vicepresidente del proveedor de servicios móviles Softbank. Aunque en este caso, quienes se encontraban detrás de la candidatura no se mostraban públicamente, quizás porque, como apuntaban en su programa electoral, “si te postulas para unas elecciones, perderás tu trabajo, aparecerás como un criminal y perderás la vida que has construido hasta ahora” (sic.).

Según las declaraciones de los desarrolladores y equipos de campaña de ambas iniciativas, pero también de la acogida que han tenido en las redes y los medios, podríamos deducir algunas coincidencias relevantes; por un lado, la hipotética primacía ética de un chatbot, basada en una supuesta neutralidad técnica, frente a los “intereses propios de los cargos públicos” y la intrínseca corrupción atribuida a cualquier candidatura humana. Es decir, la idea de que la automatización es más insobornable y produce mayores beneficios sociales. Por otro, la poderosa capacidad de la “autonomía tecnológica” para encubrir no solo la verdadera identidad de quienes dirigen, sostienen y determinan los ámbitos de actuación, los procesos y la toma de decisiones (una aplicación o un proveedor, en estos casos) sino también la facilidad con la que una supuesta “despolitización” impregna la agencia pública. Y además, las similitudes formales y simbólicas de las imágenes de campaña, basadas en figuras robóticas con facciones asexuadas y juveniles, en tonos plateados y azulados (herencia de fondos de pantalla) y slogan sintetizado AI-MAYOR, lo que indica un cierto imaginario asumido colectivamente como espacio con cierta autonomía y gran efectividad, que se apoya en la idea de que las tecnologías son seres emancipados de lo humano (una idea abonada por las grandes corporaciones que sustentan su mercado en este momento).

Así que lo que se proyecta con esta candidatura y con su difusión mediática es al menos lo siguiente: una idea de inteligencia antropocéntrica; integrada en un marco de competitividad IA-humanos; una desautorización global de la gestión política; la preminencia ética de la tecnología que “carece de deseos”; la supremacía de los sistemas computacionales, poseedores de unas capacidades “extraordinarias” y “autónomas”; y la idea de un sistema cibernético “ecuánime” y “objetivo”. Todo ello integrado en la misma ficción, en la misma escenificación, y envuelta en una suerte de ingenuidad tecnológica.

Parece que estamos ante un nuevo marco de relaciones tecno-políticas, referido a la dimensión más inmediata y más cercana de lo político, que tiene que ver con la gestión o administración de los asuntos públicos y como medio de distribución de los recursos. Lo que se hace evidente en la presentación de estos “candidatos” y anuncia un nuevo campo de fricciones de lo político que tiene que ver con las diversas maneras de interpretar la tensión computacional que caracteriza el momento presente.

Estos efectos concretos de la aparición de la IA se pueden observar también en el impacto de las aplicaciones de la llamada inteligencia artificial en el equilibrio ecológico, la distribución y calidad del trabajo, el respeto a la singularidad y la pluralidad, etc. que se manifiesta en la tensión extractivista y la enorme demanda energética de estas tecnologías, la desregulación y la precariedad de las condiciones laborales en las que se desarrollan, los sesgos y los prejuicios ideológicos que propagan, las prácticas reduccionistas, deterministas y autoritarias que naturalizan.

Pero hay también una expresión política1 más general, que se produce en la confluencia del nuevo sistema computacional (en el que la IA adquiere un papel muy relevante2) y la sociedad de la aceleración, la arbitrariedad y el rendimiento que habitamos3, que se da además en una época de agitación ética-onto-epistemológica4, por lo tanto, en un momento de especial incertidumbre, de confusión, de fragilidad.

*

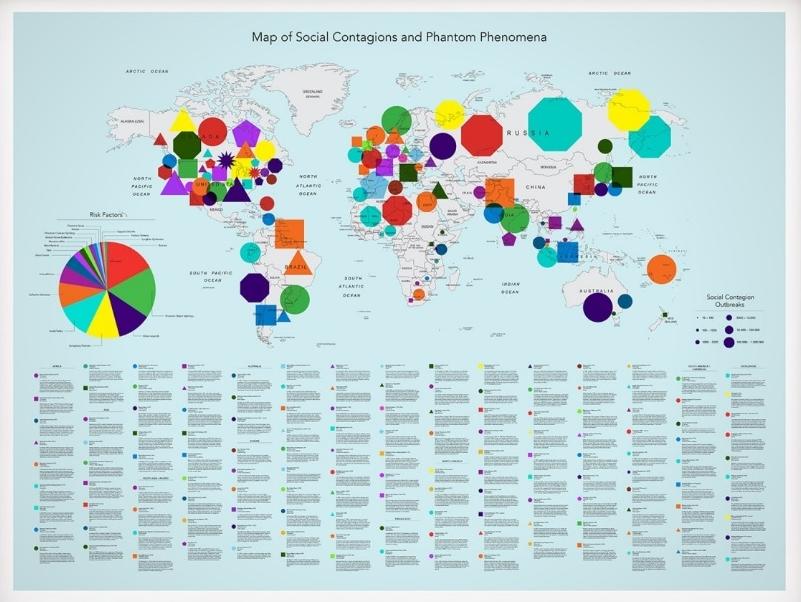

Agnieszka Kurant había imaginado su exposición Risk Landskape como un mapa de expectativas de riesgos (como su propio nombre indica). En colaboración con diferentes expertos en gestión de datos y modelos de catástrofes, y con el empleo de IA, elaboró “tres hologramas que muestran simulaciones de eventos financieros, políticos y climáticos que se prevé que surjan en áreas geográficas específicas de todo el mundo”. Según sus propias palabras, trata de problematizar la “concepción contemporánea del futuro como un objeto especulativo”.

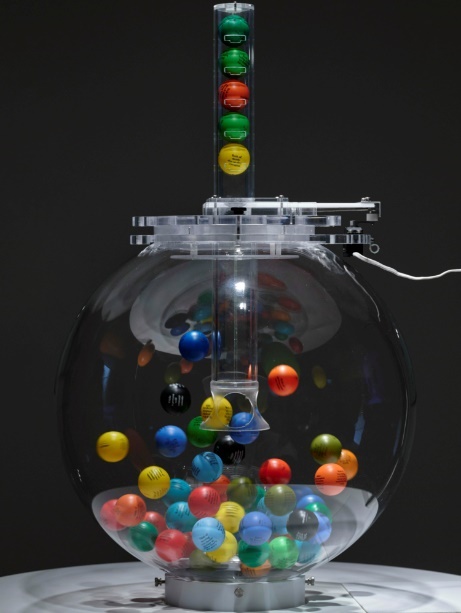

Entre las diversas piezas instaladas, se hallaba un bombo de lotería con bolas saltarinas de diversos colores, que se mostraban en el expositor a intervalos regulares de tiempo. Junto a la esfera, se encontraba un mapamundi que hacía ahora referencia a la gestión de algunos de estos riesgos. Ambos se titulaban Lottocracy y Risk Management.

Como se sabe “lottocracy” o lotocracia es un modelo de gobernanza basado en el sorteo, es decir, una propuesta que plantea la sustitución de los procesos electorales por rifas para seleccionar los representantes políticos.

En este caso, la rifa se realiza entre distintos cálculos y estadísticas, que se refieren por ejemplo a la posibilidad de que un artista consiga vivir de su arte, o a que podamos ser alcanzados por un rayo a lo largo de nuestra vida. Variables que se ubican geográficamente en el mapa de gestión de riesgos.

La autora indica que “hoy el futuro se está convirtiendo en un bien raíz especulativo” y explica que la exposición “trata sobre las huellas del futuro en el presente y las tecnologías que especulan sobre ello y explotan varios tipos de futuros”5 .

*

En 2017 la filósofa Déborah Danowiski y el antropólogo Eduardo Viveiros de Castro6 acuñaron la expresión “arrebatamiento cibernético” para indicar el período en el que las capacidades computacionales de las máquinas se sitúan en el centro de nuestras preocupaciones, en una supuesta competencia con las habilidades y potencialidades humanas. Parece que ese momento ha llegado y con él esa intensidad que va del entusiasmo al temor, pasando por la perplejidad.

Lo que llamamos IAG está basado en grandes modelos estadísticos con capacidad de hallar patrones y correlaciones en enormes conjuntos de datos con el objeto de señalar predicciones. Esto, por un lado, está posibilitando desarrollos impresionantes en muchos campos del saber7 pero, por otro lado, la IA está cada vez más presente en ámbitos como la percepción remota o el control robótico aplicados a políticas coactivas, intromisiones en la privacidad, alteraciones y suplantaciones en la información o implementación en el ámbito militar (por nombrar algunas de las más usuales y más escandalosas).

Todo ello en un escenario que nos augura una aplicación generalizada y acrítica en todos los ámbitos de la vida, sólo atenuada por la rentabilidad y la efectividad en cada caso, lo que supone una enorme e indiscriminada intervención política. En su desarrollo actual, la IA “se nos presenta como una fuerza alienante que amenaza con totalizar la producción de conocimiento y la determinación de las reglas”8.

Como indica Luciano Floridi (2024), “quien no se encuentre perplejo ante la revolución digital de las IAs es que no ha captado aún la magnitud de la misma”.

Para Kate Crawford9, “lo que estamos viendo ahora con la industria de la IA es un proceso en tres partes: abstracción, extracción y distracción”. Podemos afirmar que estas tres partes son también tres características del proceso político en el que nos encontramos. La abstracción tiene que ver con la manera fantasmagórica y tenebrosa en que se nos presenta la IA, envuelta en nociones desubicadas y parciales de términos como “inteligencia”, “artificial” o “generativa”; la extracción con cómo ha irrumpido en la estructura socioeconómica acentuando la competencia extractivista y provocando una descomunal devastación de los recursos; y la distracción con una gigantesca campaña publicitaria, basada en fábulas y quimeras de todo tipo, apoyadas en inversiones mastodónticas y programas de ingeniería social despiadados.

Este proceso- que Eric Sadin considera“un crimen contra la condición humana”10, y que Yuval Noah Harari (2024) insiste en que “tenemos que entender que existe un potencial totalitario en la IA como nada de lo que hemos visto hasta ahora en la historia”- se fundamenta en una interpretación diluida, desubicada y enmarañada de la idea antropocéntrica de “inteligencia”, en una concepción simple e irreflexiva de lo “artificial”, y en un sistema de elaboración de respuestas (mediante la apropiación indiscriminada de datos) que es opuesto a la idea de “generatividad” (que tiene que ver con la aportación contextual).

Se ha construido un imaginario dulcificado y fantasioso que Erik Davis (2023) llama tecnomisticismo y que actúa como una fenomenal pantalla que oculta los efectos sobre “expectativas, ideologías, deseos y miedos” en palabras de Kate Grawford (2022) … “la IA es una idea, una infraestructura, una industria, una forma de ejercer el poder y una manera de ver; también es la manifestación de un capital muy organizado respaldado por vastos sistemas de extracción y logística, con cadenas de suministro que abarcan todo el planeta”.

En este sentido, Adrienne Williams, Milagros Miceli y Timnit Gebru (2023) indican cómo “lejos de las máquinas inteligentes y sofisticadas retratadas en los medios y la cultura pop, los llamados sistemas de inteligencia artificial son alimentados por millones de trabajadores mal pagados en todo el mundo que realizan tareas repetitivas en condiciones laborales precarias”. Tratándose de la IA, a estos millones de trabajadores habría que añadir el “saqueo masivo de internet”, es decir, la apropiación despiadada de los datos de los usuarios de internet, redes sociales y aplicaciones, los llamados data doubles, para el entrenamiento de la IA, por parte de un pequeño grupo de grandes empresas tecnológicas con la capacidad, los medios y los apoyos necesarios11. Estamos ante una “automatización alimentada por humanos, que se aplica desde la minería hasta el crowdsourcing, pasando por el software”12.

*

Placas fotolitográficas de imágenes algorítmicas mediante el modelo de difusión texto-imagen

En 1959 y en su estudio para el diagnóstico de la esquizofrenia, el neurólogo alemán Klaus Conrad llamó apofenia al hecho de hallar conexiones entre acontecimientos que no están relacionados.

El Centro Pompidou retomó este término para aplicarlo a las IAs en tanto que vinculan cosas que en principio no tienen relación (las llamadas “falsas conexiones” y “alucinaciones”). Millones de personas usan a diario estos resultados impredecibles, porque forman parte de la herramienta y en consecuencia se establecen como componentes. Según indican sus organizadores, “no se trata solo de considerar las consecuencias potenciales de esta nueva tecnología, sino también de comprender cómo están empezando a modificar y dar forma a nuestro mundo social”.

La exposición, inaugurada en setiembre de este año y situada en la Galería de arte gráfico del Museo, se llama Apophenia, interruptions. Artistes et intelligences artificielles au travail, y estará abierta hasta enero de 2025.

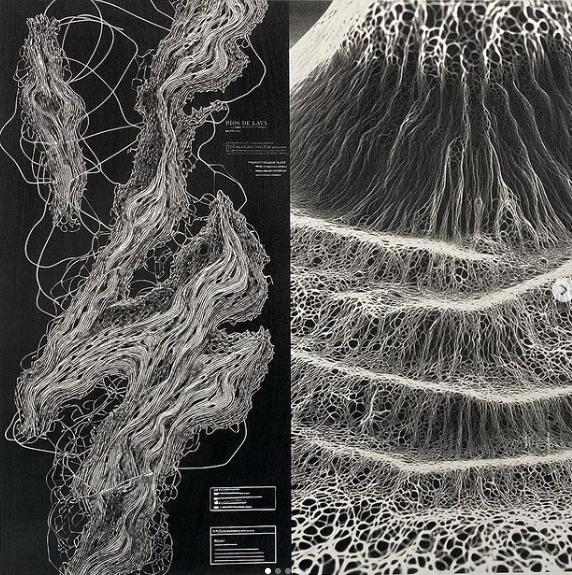

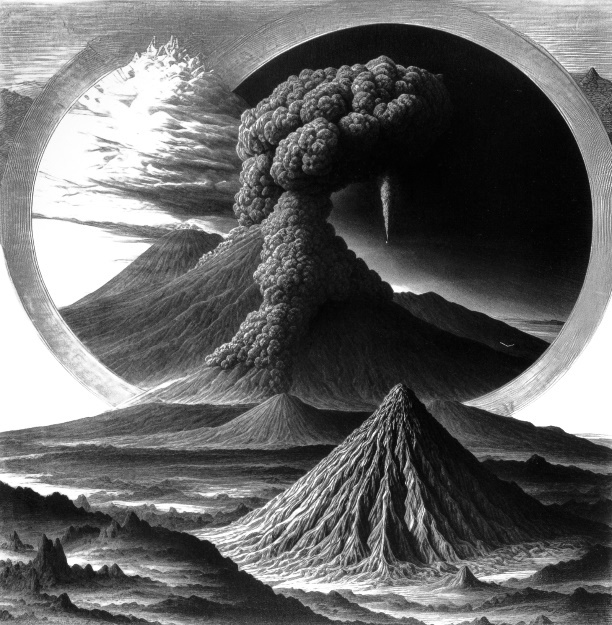

Entre los trabajos mostrados, se encuentra una serie de placas fotolitográficas presentadas con el nombre de Volcanic por el “colectivo nómada y multiespecie” Interspecifics, una “oficina de investigación artística” cuyo objetivo es investigar “posibles formas de comunicación no humana” mediante la exploración de patrones en las bioseñales que emiten estos organismos y en la relación con su morfología.

“Volcanic”13 es una reflexión acerca de las capacidades de intervención de las IAs- en concreto, de las imágenes emitidas por ellas- en las ideas, las conductas y las formas de relación. Y en este sentido, nos demanda interrogarnos acerca del nuevo carácter del lenguaje como representación codificada y lo que esto puede suponer en nuestra condición comunicativa. O también, cómo las imágenes IA se conforman como resultados de combinaciones de modelos adquiridos mediante un saqueo masivo de internet- lo que Hito Steyerl llama imágenes promediadas. Es decir, cómo las IAs incorporan nuevas interpretaciones, nuevas formas, de lenguaje y de imágenes.

Plantea además interrogantes sobre cómo afecta al sentido de la autoría en un proceso que se encuentra ahora atravesado por formas divergentes de producción de imágenes y textos. Y, en consecuencia, sobre el alcance de las posibilidades generativas de estas tecnologías o el sentido de la tecno-imaginación y la nueva interpretación que en este contexto adquieren las memorias y los registros, sometidos a procesos constantes de retroalimentación.

Lo que advierte sobre la indefensión con la que afrontamos estas alteraciones de nuestra manera de percibir e interpretar el mundo en el que vivimos, y la carencia de recursos para identificar el carácter de las imágenes y los relatos que consumimos, en tanto que se ocultan o se enmascaran los procesos en los que se hacen presentes.

*

“No es que los algoritmos y los datos hagan lo que tienen que hacer, sino que todo se entrena de forma muy específica. Y los medios nos entrenan para saber cómo actuar en una determinada situación. Eso es exactamente lo que creo que estamos haciendo dentro de los sistemas algorítmicos, por eso quiero entrenar estos sistemas para que funcionen de forma diferente o para que trabajen con los datos de forma diferente”, dice Stephanie Dinkins14.

La presentación de los últimos trabajos en proceso de Stephanie Dinkins emplea tres pantallas verticales, en la de la izquierda se pregunta acerca de los contextos culturales que posibilitan uno u otro modelo de IA. En la pantalla de la derecha, se ensaya un ejercicio de écfrasis mediante la representación textual de una imagen (“silueta de un hombre de pie”…). Y en el centro, el resultado visual de la aplicación de instrucciones verbales a un sistema de IA, en lo que algunos autores han denominado ”écfrasis inversa”.

Las deficiencias de los diseños IA, las operaciones opacas, los errores de su funcionamiento y los sesgos arrastrados en la obtención de datos, son para Dinkins “ausencias inherentes al big-data” que producen actos de “violencia algorítmica”, especialmente claros en lo que se refiere a la raza, el género, la memoria o la dependencia15.

Dinkins considera que las metodologías descolonizadoras contemporáneas se basan en prácticas de imaginación y representación. En lo referente a la imaginación, que entiende como estrategia liberadora y a su vez movilizadora, sugiere a los participantes en sus trabajos artísticos “que imaginen el futuro, sueñen un nuevo sueño y establezcan una nueva visión”, al objeto de descolonizar la propia mente. Y, en cuanto a la representación, que interpreta como “acto de soberanía política y proyecto cultural”, propone “contrarrestar la imagen dominante y tratar de mostrar las complejidades” integrando los supuestos ontológicos ignorados por los sistemas de retroalimentación de las tecnologías IA.

Para desarrollar sus trabajos, organiza espacios de colaboración para que “artistas, jóvenes y ancianos de color” puedan trabajar con científicos, informáticos, expertos y analistas de datos en “nuevas ontologías de resistencia”16.

Algo similar a lo que propuso Mimi Onuoha en 2016, con su Biblioteca de datos faltantes, una recopilación de asuntos, datos, cosas, que han sido obviadas por una sociedad tan congestionada y tan fascinada por los archivos, las memorias, los registros y repertorios de todo tipo.

“La palabra “faltante” es inherentemente normativa. Implica tanto una falta como un deber: algo no existe, pero debería existir. Lo que debería estar en algún lugar no está en el lugar esperado; un sistema establecido se ve perturbado por una clara ausencia. Lo que ignoramos revela más de lo que prestamos atención. Es en estas cosas donde encontramos indicios culturales y coloquiales de lo que se considera importante. Los espacios en blanco que hemos dejado revelan nuestros sesgos e indiferencias sociales ocultos”, dice Onuoha17.

La autora es consciente de que este “punto de recolección”18 no resolverá el complejo problema de las enormes carencias que acompañan la idea cibernética dominante, pero entiende que sirve para abrir un debate, ensayar nuevas vías de conocimiento, proporcionar un contexto más adecuado a la interpretación del papel de las tecnologías en el mundo que habitamos y también para construir espacios de conversación.

*

Sara Oscar es profesora de comunicación visual en la Escuela de Diseño de la Universidad Tecnológica de Sydney. Su madre, de origen tailandés, tuvo que emigrar a Australia en 1974 cuando tenía treinta años y se encontraba embarazada de la propia Sara.

Cerca de cincuenta años después, la hija pensó que el desarrollo de las IAs le permitirían realizar un “acto reparador” de un período importante de la experiencia de su madre del que no existía ningún tipo de documentación visual.

El proyecto parte de la idea de que, aunque las plataformas de generación de estampas no producen fotografías sino imágenes promediadas, éstas, en su uso, se perciben, se leen y se interpretan como fotografías, se confunden con ellas entrando a formar parte del imaginario del observador como si fueran instantáneas fotográficas. (Lo que plantea algunas cuestiones acerca de la peculiaridad de unas u otras representaciones, a las que un poco más delante nos referiremos brevemente).

Según nos relata la autora, el proceso de realización introdujo algunas variables no previstas, que van desde la necesidad de generar un procedimiento de tanteo y de controversia con la plataforma, hasta la reinterpretación de los resultados visuales.

Por un lado, se trataba de evitar aspectos disonantes como la desubicación del escenario (“parece que estamos en algún lugar de Los Ángeles” dice la autora); la teatralización de la escenografía, el decorado o la figura, que traslada la idea de un espectáculo ficticio; y los estereotipos raciales, directamente derivados del carácter estadístico de las estampas producidas y los sesgos que se difunden y se van asentando socialmente en la medida en que se emplean las tecnologías.

Por otro, el interés de las imágenes, que pasaban de ser el objeto de la propuesta artística, a convertirse en herramientas para un desarrollo conversacional con diversos agentes, que sirviera para la evocación de aquella experiencia no documentada.

Además de reconocer el trabajo de colaboración realizado, que implica a la propia actora de los hechos (la madre), al juego de evocaciones e identificaciones que ha establecido con las imágenes y a los efectos conversacionales propios de la práctica artística, la autora subraya que “la IA tiene el potencial de crear representaciones indirectas de nosotros y de incitar un diálogo en torno a eventos y experiencia de vida”.

Naturalmente, cualquier acontecimiento tecnológico, que implique además una alteración de las inscripciones que conforman el mundo en el que vivimos, puede incitar un diálogo de uno u otro signo. Y parece evidente que las IAs tienen el potencial de “crear representaciones indirectas de nosotros”, si queremos denominar así a la formalización de estampas promediadas. Incluso podemos aducir que ya poseemos precedentes históricos de imágenes realizadas con diversos procedimientos y técnicas, especialmente en las prácticas artísticas.

Pero lo que revela este proyecto, en su aparente naturalidad, es la capacidad de este sistema para atravesar y perturbar nuestra idea de memoria, las experiencias de nuestros recuerdos, el imaginario de nosotros mismos, los ecosistemas en que nos reconocemos.

Las estampas promediadas entran a formar parte del imaginario de cada uno, y lo hacen como componentes post-fotográficos, es decir, copartícipes del espacio de veracidad de lo captado, ya sea por medios mecánicos o electrónicos. Participan de su consistencia docu-mental.

Se presentan como rastros de lo sucedido, sin embargo, son evocaciones tamizadas por tramas de datos indiferenciados y contaminados y, como se dice en las propias empresas tecnológicas y entre los expertos en data e IA, “basura que entra es basura que sale”19.

Y no actúan como soportes de la memoria, porque su condición promediada es indiferenciada y estadística, es decir, “representa la norma señalando el promedio [mean]. Sustituyendo los parecidos por probabilidades”20. Es una imagen normativa, no específica.

Para que pudieran actuar como “compensación de la finitud retencional de nuestro organismo”21, es decir, en este caso, como instrumento para retener, rememorar y transmitir la experiencia de su salida de Tailandia hacia Australia, estas estampas deberían ser particulares y seguramente indescifrables, impregnadas en un ecosistema específico, además de pertenecer a un escenario y a un contexto determinado, e integradas en un cierto ámbito de sentido… deberían incluir datos visuales de muy diferentes ámbitos… todo aquello que les podría permitir ser exteriorizadas como símbolos, es decir, ser entendidas como recuerdos.

Por otro lado, las imágenes intervienen en la cadena operatoria que produce nuestra percepción espacio-temporal. La vida conserva y acumula estas percepciones visuales interrelacionándolas con otros tipos de representaciones, experiencias, aspiraciones, necesidades…. en un proceso de interpretación y comprensión de lo ocurrido y de integración sociocultural, de exteriorización, de comunicación.

Los recuerdos se retroalimentan y se procesan en torno a objetos y artefactos diversos, a soportes materiales, entre ellos las imágenes22. No parece necesario subrayar el papel vertebral y el efecto contaminante de la proliferación de formas de imagen en la sociedad de control por rendimiento.

Está por ver cuáles pueden ser los efectos de la IA generativa en la construcción de lo imaginal, de qué forma y en qué sentido impregnará nuestra comprensión del mundo, de los demás y de nosotros mismos, pero lo que manifiesta la propuesta de Sara Oscar es que afectará a nuestros recuerdos, es decir, a la capacidad de relacionarnos con la información y, en consecuencia, a nuestros procesos de subjetivación o individuación.

*

BIBLIOGRAFÍA

Barad, Karen: “Meeting the Universe Halfway: Quantum Physics and the Entanglement of Matter and Meaning”, Durham, NC: Duke University Press, 2007.

Conrad, Klaus: Die beginnende Schizophrenie. Versuch einer Gestaltanalyse des Wahns (La Esquizofrenia incipiente. Intento de un análisis de la forma de la locura), Universidad de California, Thieme, 1966

Crawford,Kate: Atlas de inteligencia artificial. Poder, política y costos planetarios, Buenos Aires, Fondo de Cultura Económica, 2022.

Crawford, Kate y Paglen, Trevor: “Excavating AI. The Politics of Images in Machine Learning Training Sets”. (Excavando IA: la política de imágenes en el conjunto de entrenamiento de aprendizaje automático), 2022, libre acceso en https://excavating.ai/

Danowiski: Déborah y Eduardo Viveiros de Castro ¿Hay mundo por venir? ensayo sobre los miedos y los fines, Buenos Aires, Caja negra, 2019

Davis, Erik: Tecgnosis. Mito, Magia y misticismo en la Era de la Información, Caja negra, 2023.

Davies, Mike (Intel labs), entrevista en el diario EL PAÍS, 25.05.2024

Estorick, Alex: “Episiodio VIII, Stephanie Dinkins y el arte del aprendizaje profundo”, en Flash Art, 25.05.2021. Disponible en: https://flash—art.com/2021/05/stephanie-dinkins/ (23.09.2024)

Floridi, Luciano: Ética de la inteligencia artificial, Herder editorial, septiembre 2024.

Gabriel, Markus: “Inteligencia artificial, sus desafíos éticos” accesible en:

https://live.tec.mx/innovacion/videos/markus-gabriel-inteligencia-artificial-sus-desafios-eticos (15.09.2024)

Groys, Boris: “From Writing to Prompting: AI as Zeitgeist-Machine” (De la escritura a la incitación: la IA como máquina del espíritu de la época), revista e-flux notas, agosto 2023. https://www.e-flux.com/notes/553214/from-writing-to-prompting-ai-as-zeitgeist-machine (10.09.2024)

Han, Byung Chul: La sociedad del cansancio, Barcelona, Helder, 2012

Harari, Yuval Noah: Nexus, Una breve historia de las redes de información desde la Edad de piedra hasta la IA, Madrid, Debate, 2024

Hui, Yuk: Recursividad y contingencia, Buenos Aires, Caja Negra, 2022

Katrin M. Krampf, Katrin M. y Rogers, Christina: “Cortes digitales” en: https://transversal.at/pdf/journal-text/1659/ (24.09.2024).

Latour, Bruno: Reensamblar lo social, 2005: https://comycult.wordpress.com/wp-content/uploads/2018/04/latour-bruno-reensamblar-lo-social.pdf

McClelland, James Lloyd : “Integrating probabilistic models of perception and interactive neural networks: A historical and tutorial review”. Frontiers in Psychology, 4, p. 503, 2013.

Meillassoux, Quentin: “Iteration, Reiteration, Repetition. A Speculative Analysis of the Meaningles Sign”, en Suhail Malik y Armen Avanessian (eds.) Genealogy of Speculation, Berlín, Freie Universitat, 2012. Accesible en: https://s3.amazonaws.com/arena-attachments/886529/539a4b4a8c213179c159eefc04a28947.pdf (24.10.2024)

Noë, Alva: The Entanglement. How Art and Philosophy Make Us What We Are, (El enredo. Cómo el arte y la filosofía nos hacen lo que somos), Princeton University Press, 2023.

Onuoha Mimi: “Notes on Algorithmic Violence” en https://github.com/MimiOnuoha/On-Algorithmic-Violence (10.10.2024).

Rancière, Jacques: Política, policía, democracia. Editorial Arcis-Lom. 2006.

Sadin, Eric: “Ya no se distingue la verdad de la mentira” entrevistado en CLARIN, revista Ñ, el 29.04.2024. accxesible en: https://www.clarin.com/revista-n/eric-sadin-distingue-verdad-mentira_0_cgA6aDP4yd.html?srsltid=AfmBOoq9l22JTxQd8vSFPZ_teX3oA9lU23NgBBKi4TUKSJQCEYKJUoUH#google_vignette (15.12.2024)

Sadin, Eric: La inteligencia artificial o el desafío del siglo, Buenos Aires, Caja Negra, 2020.

Steyerl, Hito: “Imágenes promedio”, en New Left Review, mayo-agosto 2023, pp. 95 y 97. Accesible en https://newleftreview.es/issues/140/articles/mean-images-translation.pdf

Stiegler, Bernard: Philosopher par accident : Entretiens avec Elie During, París, Galilée, 2004.

Stiegler, Bernard: El Tiempo y la Técnica, Ediciones Hiru, Hondarribia 2003.

Williams, Adrienne; Miceli, Milagros y Gebru, Timnit: “The Exploited Labor Behind Artificial Intelligence”, Noema Magazine, 2023.

NOTAS

1 En el sentido indicado por Jacques Rancière (2006).

2 Yuk Hui (2022).

3 Byung Chul Han (2012)

4 Karen Barad (2007)

5 https://artmap.com/mudam/exhibition/agnieszka-kurant-2024

6 Déborah Danowiski y Eduardo Viveiros de Castro (2019).

7 quizás los más difundidos son aquellos que tiene que ver con la medicina y la salud, pero a diario se nos informa de nuevos avances extraordinarios en muy diversos ámbitos, por ejemplo, acabamos de conocer que la IA ha permitido visibilizar 303 geoglifos en el desierto de Nazca, que son tantos como los encontrados en el último siglo (El País-Arqueología, 23.09.2024: https://elpais.com/ciencia/2024-09-23/la-inteligencia-artificial-desentierra-303-nuevas-figuras-en-el-desierto-de-nazca.html) o impresionantes logros, como el mapa del cerebro de la mosca de la fruta, elaborado a partir de 21 millones de imágenes tomadas de un cuerpo de menos de un milímetro (SInC, 02.10.2024: https://www.agenciasinc.es/Noticias/Por-que-es-importante-tener-el-mapa-completo-del-cerebro-de-la-mosca-de-la-fruta).

8 Yuk Hui (2022) p.377.

9 Cate Crawford (Escuela Normal Superior de París- Investigadora principal de Microsoft), entrevista en La Tercera 15.01.2024: https://www.latercera.com/que-pasa/noticia/kate-crawford-la-experta-que-acusa-a-los-multimillonarios-tech-del-miedo-a-la-inteligencia-artificial/D6KYVNQSANEI3BH7NHRJBBOJO4/#

10 Conferencia en el MALBA (Museo de Arte Latinoamericano de Buenos Aires) 17.04,2024. Accesible en: https://www.youtube.com/watch?v=0MYePfKdQ0E (22.09.2024)

11 Katrin M. Krampf y Christina Rogers recuerdan cómo en 2011, “el activista vienés Max Schrems utilizó la legislación europea de protección de datos para obligar a Facebook a entregar los datos que la red social había acumulado sobre él. Recibió un CD con más de 1000 páginas de información recopilada … no solo contenía publicaciones hechas por él mismo, como selfies, chats o datos sobre sus amigos de Facebook, sino también una especie de perfil sombra, datos borrados hace mucho tiempo y una gran cantidad de metadatos, como ubicaciones, direcciones IP y ordenadores que había usado, etc.

Ver su artículo “Cortes digitales” en: https://transversal.at/pdf/journal-text/1659/ (24.09.2024).

12 Kate Crawford entrevistada por Ana Vidal Egea para El País, 02.08.2023.

13 https://pcg.photo/pdf/la_imagen_codificada.pdf

14 Tomado de, Alex Estorick (2021)

15 El término “violencia algorítmica” ideado por Mimi Onuoha (2024) se refiere a “la violencia que un algoritmo o un sistema automatizado de toma de decisiones inflige al impedir que las personas satisfagan sus necesidades básicas. Es el resultado de sistemas sociales, políticos y económicos explotadores y se ve amplificada por ellos, pero también puede estar íntimamente relacionada con efectos espaciales y físicos”.

16 Puede verse: https://macaccess.org/program/guggenheim-minds-eye-featuring-stephanie-dinkins-the-stories-we-tell-our-machines/

17 Para una información completa ver https://github.com/MimiOnuoha/missing-datasets (10.10.2024)

18 Mimi Onuoha ha publicado cinco tesis acerca de la recogida de datos, que le han servido de base para su punto de recolección en: https://thelivinglib.org/the-point-of-collection/ (10.10.2024)

19 The Algorithm from MIT Technology Review, oct. 2024

20 Hito Steyerl, “Mean Images” en New Left Review, 140-141, 2023. Accesible en: https://newleftreview.org/issues/ii140/articles/hito-steyerl-mean-images (17.10.2024)

21 La llamada por Stiegler (2004) “retención terciaria”.

22 Es lo que Stiegler (2003) denominó “exteriorización de la memoria”.